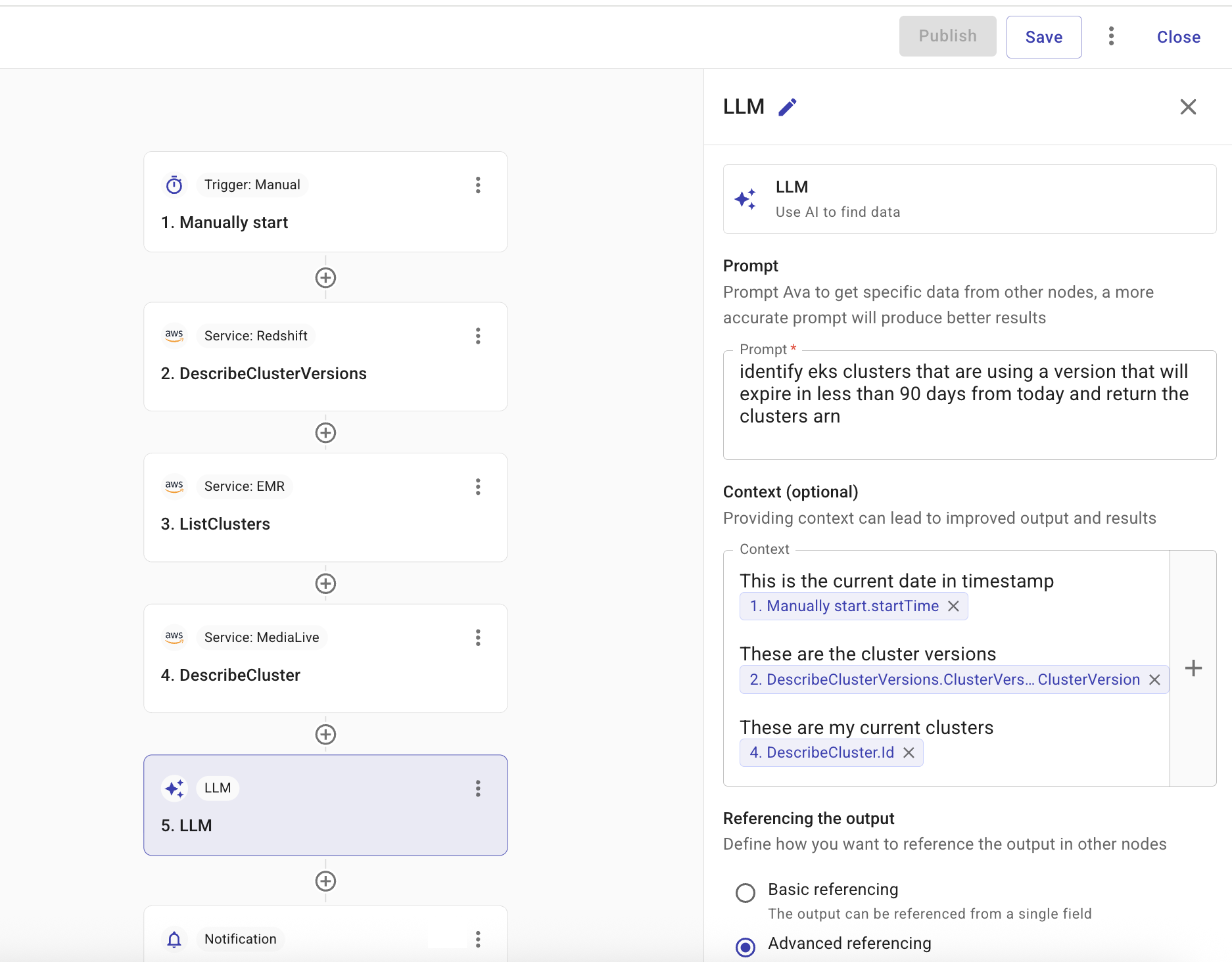

LLM ノード

Large Language Model(LLM)ノードは、データの処理・分析・整形のために設計されています。OpenAI や AWS Bedrock を利用した LLM モデルにより、データの解釈・生成・変換を行うことができます。複雑なフローロジックを定義する代わりに、Identify eks clusters that are using a version that will expire in less than 90 days from today and return the clusters arn のようなプロンプトを指定するだけで済みます。LLM ノードは、生成されたデータをフロー内の他のノードで利用できるようにし、後続のアクションに渡すことができます。

さらに、フロー内の前のノードから特定のフィールドを参照することで、より正確で一貫した出力を��得ることができます。値とフィールドタイプの参照方法については、Node parameters を参照してください。LLM ノードは、生成されたデータを単一フィールドまたは JSON オブジェクトとして出力し、通知の送信など、フローの次のステップで利用できるようにします。

-

Prompt: プロンプトを入力

-

(オプション)Context: LLM モデルに追加のコンテキストを提供するための動的コンテンツを追加

-

Referencing the output:

-

Basic referencing: 出力を単一フィールドとして参照します。単純な戻り値に使用します。

-

Advanced referencing: JSON スキーマを定義し、出力内の特定フィールドを下流ノードから個別に参照できるようにします。プロンプトを入力した後、Suggest schema を使用してプロンプトから JSON Schema のたたき台を生成し、その後スキーマフィールドで内容を調整できます。スキーマの定義方法については、Output schema を参照してください。json-schema.org にある一般的なスタンドアロンの JSON Schema の例とは異なり、CloudFlow の出力スキーマは完全な JSON Schema ドキュメントではありません��。そのフィールドに

$schema(例えばdraft/2020-12の URL)や$idを含めないでください。これらはサポートされておらず、スキーマが想定どおりに動作しない原因となります。

-

テスト

ノードをテストするには、Test を選択してください。